Internet ngày nay không còn là không gian mà chúng ta từng biết. Mỗi tuần, hàng triệu người dùng tranh cãi với các mạng lưới bot AI và những nhân viên được trả lương tại các “troll farm” (trang trại tạo tin giả) như Internet Research Agency (IRA). Đây là một tổ chức của Nga có trụ sở tại St. Petersburg, nổi tiếng với các chiến dịch gây ảnh hưởng trực tuyến được nhà nước tài trợ, nhắm vào Hoa Kỳ và Châu Âu. Vào thời kỳ đỉnh cao, IRA có từ 300–400 nhân viên làm việc theo ca, tạo ra hàng chục nghìn bài đăng mỗi tháng với ngân sách 1 triệu đô la Mỹ hàng tháng. Trong các sự kiện nổi bật vào những năm 2010, có tới một trong ba tương tác trên mạng xã hội là không xác thực. Giờ đây, với sự trợ giúp của AI, con số này tăng lên theo cấp số nhân.

Trong những năm gần đây, một lý thuyết từng bị coi là “âm mưu” đã quay trở lại trong các cuộc thảo luận — Lý thuyết Internet Chết (Dead Internet Theory). Lý thuyết này cho rằng hầu hết nội dung và tương tác trên internet không còn được tạo ra bởi con người thật mà bởi các bot, phương tiện truyền thông do AI tạo ra và các nhiễu loạn được thuật toán khuếch đại. Trọng tâm của lý thuyết là niềm tin rằng các nền tảng, chính phủ hoặc tập đoàn đã đồng lõa trong quá trình nhân tạo hóa này, hoặc là do thiết kế hoặc vì lợi nhuận.

Thoạt nhìn, điều này có vẻ giống thuyết âm mưu, nhưng ẩn sâu bên dưới tuyên bố đó là một sự thật đen tối hơn. Chúng ta ngày càng điều hướng trong một thế giới kỹ thuật số nơi tính xác thực được sản xuất hàng loạt. Với sự trỗi dậy của AI tạo sinh, việc sản xuất thông tin sai lệch đã trở nên rẻ hơn và nhanh hơn. Mặc dù Lý thuyết Internet Chết chỉ ra một sự bóp méo thực sự và ngày càng tăng trong cách mọi người trải nghiệm web, giờ đây nó được hỗ trợ bởi các nghiên cứu báo chí, an ninh mạng và các công trình học thuật. Kết quả là một vòng lặp phản hồi của sự lan truyền theo kiểu trình diễn, nơi các xu hướng được thúc đẩy ít hơn bởi sự quan tâm thực sự và nhiều hơn bởi động lực được “kỹ nghệ hóa”. Tất cả các tài liệu nghiên cứu và tài liệu rò rỉ được sử dụng cho bài viết này có thể được tải xuống từ XDA Mega Drive của chúng tôi.

Internet không chết — nó chỉ bị bóp méo

Một lý thuyết “âm mưu” trở nên phù hợp hơn bao giờ hết

Lý thuyết Internet Chết lập luận rằng kể từ khoảng năm 2016 hoặc 2017, internet đã trở nên ngày càng tổng hợp — được lấp đầy bởi các nhân vật ảo, các bài báo tự động tạo và tương tác tự động — trong khi hoạt động của con người đích thực bị nhấn chìm. Lý thuyết này bắt nguồn từ các cuộc thảo luận trên các diễn đàn như 4chan và Wizardchan, và thu hút sự chú ý rộng rãi hơn sau một bài đăng trên diễn đàn Agora Road vào năm 2021 bởi một người dùng tên là IlluminatiPirate. Một năm sau, ChatGPT được phát hành ra công chúng, và các nhà báo bắt đầu xem xét lại lý thuyết này.

Vào tháng 1 năm 2024, Dani Di Placido, một cộng tác viên cao cấp tại Forbes, đã xuất bản một bài viết giải thích về Lý thuyết Internet Chết — nhưng lại bỏ lỡ những điểm cốt lõi.

“Chắc chắn có bot ngoài kia, nhưng lý thuyết này không mô tả internet ngày nay, chứ đừng nói đến năm 2021. Các trang mạng xã hội luôn thực hiện các biện pháp chặn bot spam và vẫn làm như vậy, ngay cả khi các bot đang phát triển, được hỗ trợ bởi AI tạo sinh.

Hiện tại, AI tạo sinh không có khả năng tự tạo ra nội dung tốt, đơn giản vì AI không thể hiểu ngữ cảnh. Phần lớn các bài đăng lan truyền — những ý kiến không kiểm soát, lời nói dí dỏm, quan sát sâu sắc, làm mới những điều quen thuộc trong một ngữ cảnh mới — không phải do AI tạo ra.”

Trong khi các ước tính đôi khi cao hơn, ít nhất 40-50% internet có thể truy cập được cho là giả mạo. Và thành thật mà nói, bạn có lẽ không cần phải thuyết phục rằng chưa đến một nửa nội dung trực tuyến là đáng tin cậy — gần như mọi nghiên cứu lớn đều xác nhận những gì hầu hết mọi người đã biết từ kinh nghiệm. Tự do internet đang ở mức thấp nhất mọi thời đại, và những tiến bộ trong AI đang làm mọi thứ trở nên tồi tệ hơn nhiều.

Di Placido và nhiều nhà báo chính thống khác đã không nhận ra rằng AI tạo sinh không hoạt động độc lập. Luôn có một con người đứng sau, sử dụng nó một cách có chủ đích. Vấn đề không phải là liệu AI có thể tự sản xuất nội dung tốt hay không — mà là cách nó được sử dụng để sản xuất hàng loạt tương tác, bóp méo khả năng hiển thị và làm ngập các nền tảng bằng ảnh hưởng tổng hợp cùng các chiến dịch thông tin sai lệch trực tuyến được đẩy mạnh.

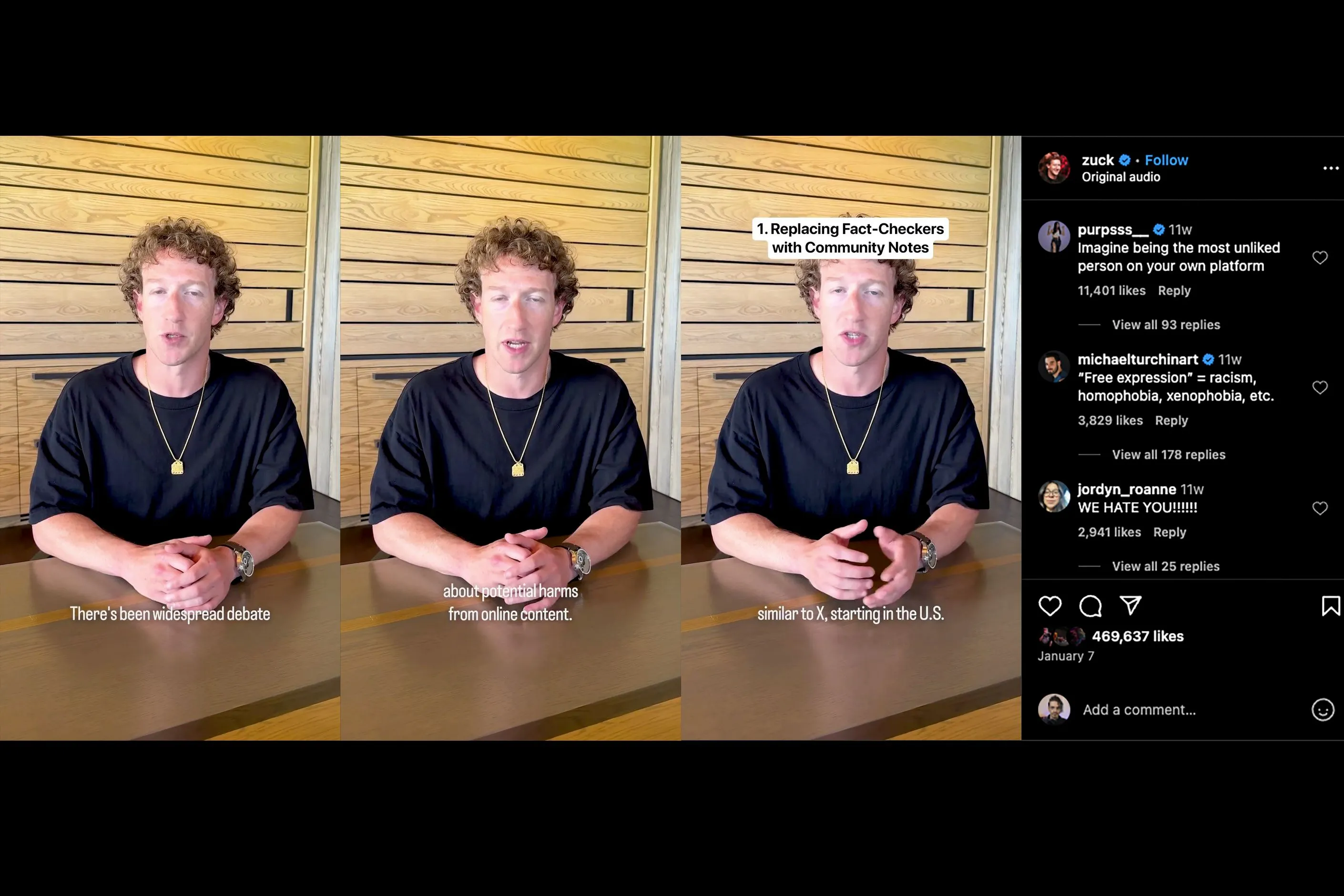

Mark Zuckerberg thông báo ngừng kiểm tra thông tin trên các nền tảng của Meta và các bình luận tiêu cực trên Instagram.Nguồn: Instagram

Mark Zuckerberg thông báo ngừng kiểm tra thông tin trên các nền tảng của Meta và các bình luận tiêu cực trên Instagram.Nguồn: Instagram

Về ý tưởng rằng các công ty mạng xã hội đang tích cực chống lại điều này, thật nực cười. Các nền tảng này kiếm lợi từ sự không xác thực. Nó được tích hợp vào cách chúng hoạt động. Zuckerberg đã công khai thông báo Meta sẽ ngừng kiểm tra thông tin trên tất cả các nền tảng của mình. Musk đã đóng cửa toàn bộ đội ngũ an toàn bầu cử của Twitter vào năm 2023, sau đó vài tháng đã ra mắt một cái gọi là Cộng đồng Toàn vẹn Bầu cử — một nhóm 50.000 thành viên tràn ngập các thuyết âm mưu về gian lận cử tri và thao túng phiếu bầu.

Và chúng ta biết sự ủng hộ của Musk dành cho Trump đã đưa ông ấy đến đâu — giơ tay chào kiểu Quốc xã trên sân khấu, can thiệp vào chính trị Hoa Kỳ và Đức, tự định vị mình là một thành viên nội các không được bầu thông qua Doge, làm giảm giá trị của Tesla, và trở thành một trong những người bị ghét nhất hành tinh. Vì vậy, không có gì là xa vời khi nghĩ rằng ông ấy sẽ tích cực định hình nền tảng để phản ánh cùng một thực tế được tạo ra mà Lý thuyết Internet Chết mô tả.

Ảo ảnh về tương tác và tương tác giả tạo

Tuyên truyền quy mô lớn áp đảo tiếng nói hữu cơ

Khi tôi nhắc đến bot, tôi muốn nói đến toàn bộ phổ nội dung không xác thực — các nhân vật do AI tạo ra, nhân viên troll farm, những người theo dõi giả, các phản hồi được sản xuất hàng loạt — bất cứ thứ gì được thiết kế để mô phỏng tương tác của con người thật mà không thực sự là như vậy. Nếu gần đây internet cảm thấy giả tạo, bạn không hề sai — và đó không chỉ là chính trị. Bot đang tràn ngập mọi sự kiện lớn, từ bầu cử đến văn hóa đại chúng, từ đưa tin chiến tranh đến quảng bá thương hiệu.

Thế hệ botnet AI mới này không chỉ bắt chước sự tham gia; chúng còn vượt trội hơn. Chúng nhanh chóng, không mệt mỏi và được xây dựng để thao túng các thuật toán vốn thưởng cho hoạt động hơn là tính xác thực. Những gì thịnh hành không phải là những gì mọi người coi trọng — mà là những gì gây ra phản ứng mạnh nhất. “Rage bait” (nội dung gây tức giận) tác động mạnh hơn, tăng đột biến dopamine và khiến mọi người quay lại để tìm kiếm thêm.

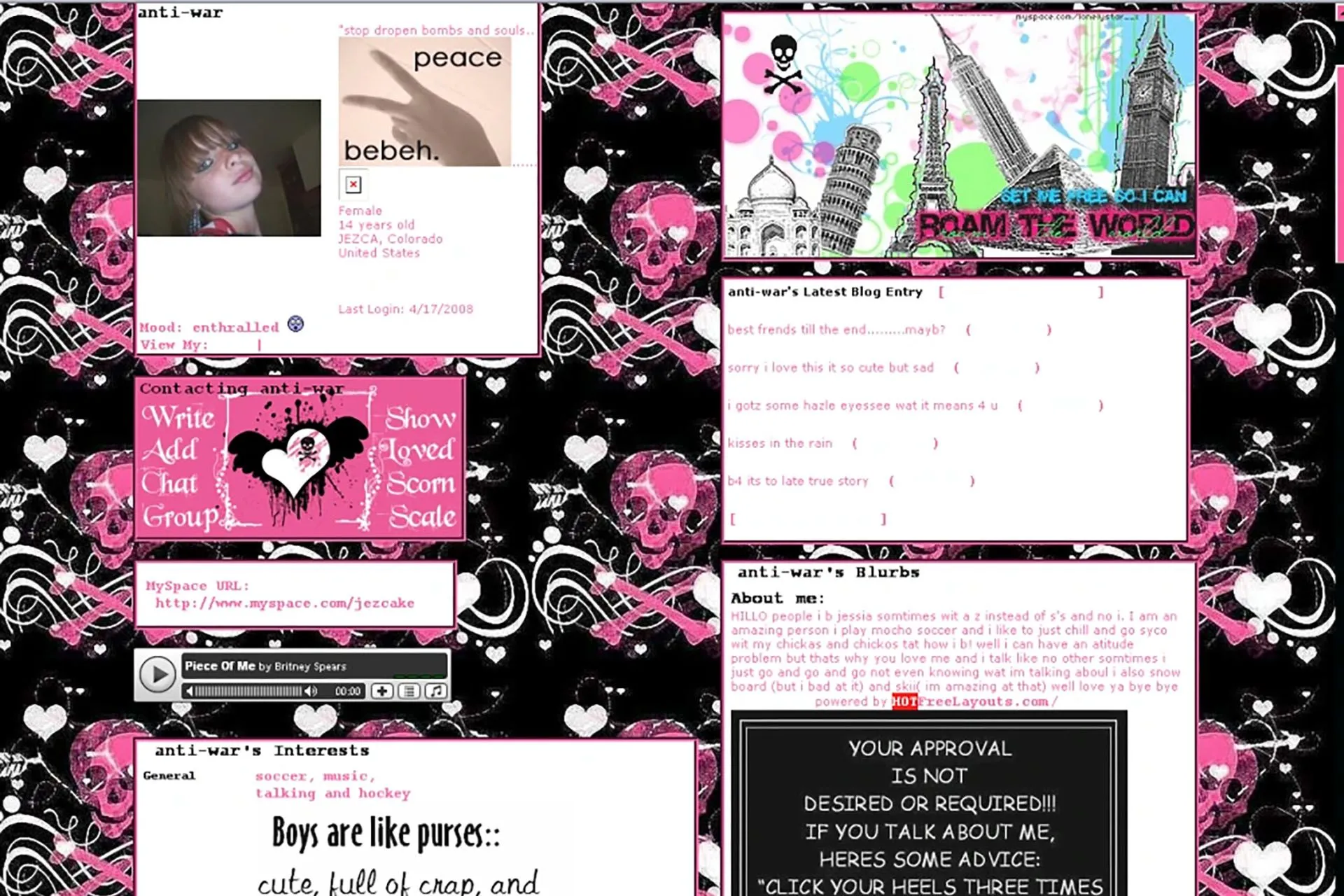

Sự dịch chuyển khỏi nội dung hữu cơ không xảy ra cùng một lúc, nhưng đối với tôi, điều đó trở nên rõ ràng khi MySpace buộc phải tái thiết kế vào năm 2010. Trang web này từng cho phép bạn định hình không gian của riêng mình — mã tùy chỉnh, âm nhạc, sở thích thực tế của bạn — và đột nhiên tất cả bị san phẳng thành một hồ sơ chung chung mà không ai yêu cầu. Đó là khi mọi người bắt đầu rời đi, và tôi không đổ lỗi cho họ.

Điều đọng lại trong tôi không phải là giao diện — mà là những gì nó nói về nơi mọi thứ đang diễn ra. Chúng ta đã đi từ tùy chỉnh sang đồng nhất, từ biểu hiện sang trình diễn, từ đối thoại sang dòng tin tức.

Ví dụ hồ sơ MySpace trước khi tái thiết kế, cho phép tùy chỉnh cao với mã nguồn, nhạc nền và sở thích cá nhân.Nguồn: MySpace

Ví dụ hồ sơ MySpace trước khi tái thiết kế, cho phép tùy chỉnh cao với mã nguồn, nhạc nền và sở thích cá nhân.Nguồn: MySpace

Trong những năm đầu tiên đó, internet giống như một lối thoát. Đó là nơi mọi người chia sẻ những trải nghiệm thực — âm nhạc, câu chuyện, ý tưởng, nỗi đau, sự hài hước — và đối với một người bị mắc kẹt trong một thị trấn nhỏ, điều đó có ý nghĩa rất lớn. Tôi đã xây dựng các mạng lưới giúp tôi đi lưu diễn với tư cách một nhạc sĩ, gặp gỡ hàng nghìn người và kết bạn mà tôi vẫn thân thiết cho đến ngày nay. Dù tốt hay xấu, nó cho cảm giác như bạn đang thực sự kết nối với những con người khác.

Tất nhiên là có những kẻ ngốc nghếch — một số chỉ gây rối cho vui, những người khác chỉ cay đắng và độc hại — nhưng nó không bao giờ cảm thấy giả tạo. Nó giống như những người thô lỗ, chứ không phải một chiến dịch của công ty. Đó là điểm khác biệt bây giờ. Điều từng là một người gây hỗn loạn đã leo thang thành một thứ gì đó hoàn toàn khác. Nó nhanh hơn, phối hợp hơn, và thường không phải là con người. Và nó không chỉ là về việc troll nữa — mà là về việc kiểm soát câu chuyện.

Ai đứng sau mạng lưới bot khổng lồ này?

Thao túng có chủ đích từ các quốc gia và chiến tranh tâm lý

Cuộc chiến thông tin mà chúng ta đang sống không bắt đầu với mạng xã hội — nó là hình thức hiện đại của một thứ đã phát triển trong nhiều thập kỷ. Tuyên truyền đã là một chiến trường trong Thế chiến II và Chiến tranh Lạnh, và các hoạt động tâm lý từ lâu đã là một phần của chiến lược quân sự và tình báo. Nhưng sự thay đổi mà chúng ta đang thấy hiện nay — nơi thông tin sai lệch là liên tục, có thể mở rộng và tương tác — có thể được truy tìm trực tiếp từ các thí nghiệm của Nga vào những năm 2000.

Sau sự sụp đổ của Liên Xô, Nga phải đối mặt với thảm họa kinh tế, bất ổn xã hội và ảnh hưởng toàn cầu giảm sút. Điện Kremlin đã phản ứng bằng cách đầu tư vào việc kiểm soát câu chuyện. Một trong những kiến trúc sư của nỗ lực này là Vladislav Surkov, một cố vấn của Vladimir Putin, người đã công khai ủng hộ tuyên truyền mâu thuẫn, gây nhầm lẫn có chủ đích và hỗn loạn thông tin như những công cụ quản lý. Đây không phải là về việc khiến mọi người tin vào một sự thật duy nhất — mà là về việc gây bất ổn cho chính khái niệm sự thật.

Cách tiếp cận đó đã thành hình thông qua Internet Research Agency, nơi trở thành một mô hình để công nghiệp hóa thông tin sai lệch. Các nhân viên của họ không chỉ là những kẻ troll — họ tuân theo định mức, sử dụng các hướng dẫn phong cách nội bộ và vận hành các nhân vật giả mạo xuyên suốt các ranh giới ý thức hệ để kích động chia rẽ và làm xói mòn lòng tin. Một số đóng vai những người bảo thủ cực đoan, những người khác là các nhà hoạt động Black Lives Matter. Sự hỗn loạn là có chủ ý.

Các cơ quan tình báo Hoa Kỳ đã xác nhận sự liên quan của họ trong cuộc bầu cử năm 2016. Nhưng mục tiêu lớn hơn không bao giờ chỉ là bầu cử — mà là gây bất ổn lâu dài. Đẩy đủ nhiễu loạn vào hệ thống, và hệ thống sẽ bắt đầu thất bại. Mọi người ngừng tin vào sự thật, vào các thể chế, vào nhau. Các troll farm đã tiếp cận 140 triệu người Mỹ mỗi tháng trên Facebook trước cuộc bầu cử năm 2020.

Các quốc gia khác cũng làm theo kịch bản tương tự. Ngày nay, hơn 70 chính phủ — bao gồm Trung Quốc, Iran, Ả Rập Xê Út, Israel, Ấn Độ, Venezuela và thậm chí cả Hoa Kỳ — đều điều hành các chương trình thông tin sai lệch có tổ chức. Dù được thực hiện thông qua các nhân vật do AI tạo ra, các troll farm hay các mạng lưới khuếch đại bí mật, chiến lược vẫn giống nhau: biến sự chia rẽ thành một vũ khí và để công chúng làm phần còn lại.

Mặc dù có nhiều bằng chứng cho thấy chiến tranh kỹ thuật số đang leo thang, Bộ trưởng Quốc phòng Pete Hegseth đã tạm dừng tất cả các hoạt động tấn công mạng nhắm vào Nga. Động thái này là một phần của việc cắt giảm rộng hơn các sáng kiến của Hoa Kỳ nhằm giải quyết các mối đe dọa trực tuyến — từ việc giải tán các đội an ninh bầu cử đến việc cắt giảm đầu tư liên bang vào phòng thủ mạng. Với ít biện pháp đối phó hơn, khối lượng và sự tinh vi của thông tin sai lệch sẽ chỉ tăng lên. Nhiều thứ chúng ta thấy trực tuyến sẽ là bịa đặt, và chúng ta sẽ phải điều hướng nó với ít sự bảo vệ hơn.

Hình ảnh tổng thống Donald Trump, tỷ phú Elon Musk và tổng thống Vladimir Putin, đại diện cho các thế lực có khả năng thao túng thông tin.Nguồn: Wiki Commons – Buaidh

Hình ảnh tổng thống Donald Trump, tỷ phú Elon Musk và tổng thống Vladimir Putin, đại diện cho các thế lực có khả năng thao túng thông tin.Nguồn: Wiki Commons – Buaidh

Thao túng nội địa từ những người có ảnh hưởng và lợi ích doanh nghiệp

Thông tin sai lệch có sự phối hợp không chỉ giới hạn ở các tác nhân nhà nước. Những người có ảnh hưởng, các nhân vật chính trị và lợi ích doanh nghiệp thường xuyên sử dụng các phương pháp tương tự để định hình nhận thức của công chúng. Sự khác biệt nằm ở động cơ, chứ không phải ở cơ chế.

Vụ bê bối Cambridge Analytica đã phơi bày cách dữ liệu cá nhân có thể bị thu thập và sử dụng để xây dựng hồ sơ tâm lý, cho phép gửi thông điệp chính trị nhắm mục tiêu tối ưu hóa phản ứng cảm xúc. Mô hình đó — nội dung nhắm mục tiêu vi mô được thiết kế để gây ảnh hưởng đến hành vi — không chỉ hiệu quả mà còn trở thành phương thức tiêu chuẩn trong các lĩnh vực chính trị và thương mại.

Kể từ đó, các tác nhân nội địa đã mở rộng những chiến thuật này. Các thương hiệu và công ty quản lý danh tiếng triển khai bot để làm ngập các bài đăng bằng những bình luận ủng hộ hoặc để dập tắt những lời chỉ trích. Những người có ảnh hưởng mua lượt thích, lượt chia sẻ và bình luận để thổi phồng số liệu của họ và đủ điều kiện nhận các hợp đồng tài trợ. Các chiến dịch phối hợp mô phỏng sự phổ biến, đàn áp bất đồng chính kiến và gieo rắc các câu chuyện trên các nền tảng. Phần lớn sự tương tác này được tự động hóa hoặc thuê ngoài, và ít khi có sự tiết lộ nào phân biệt phản hồi của người dùng đích thực với sự khuếch đại tổng hợp.

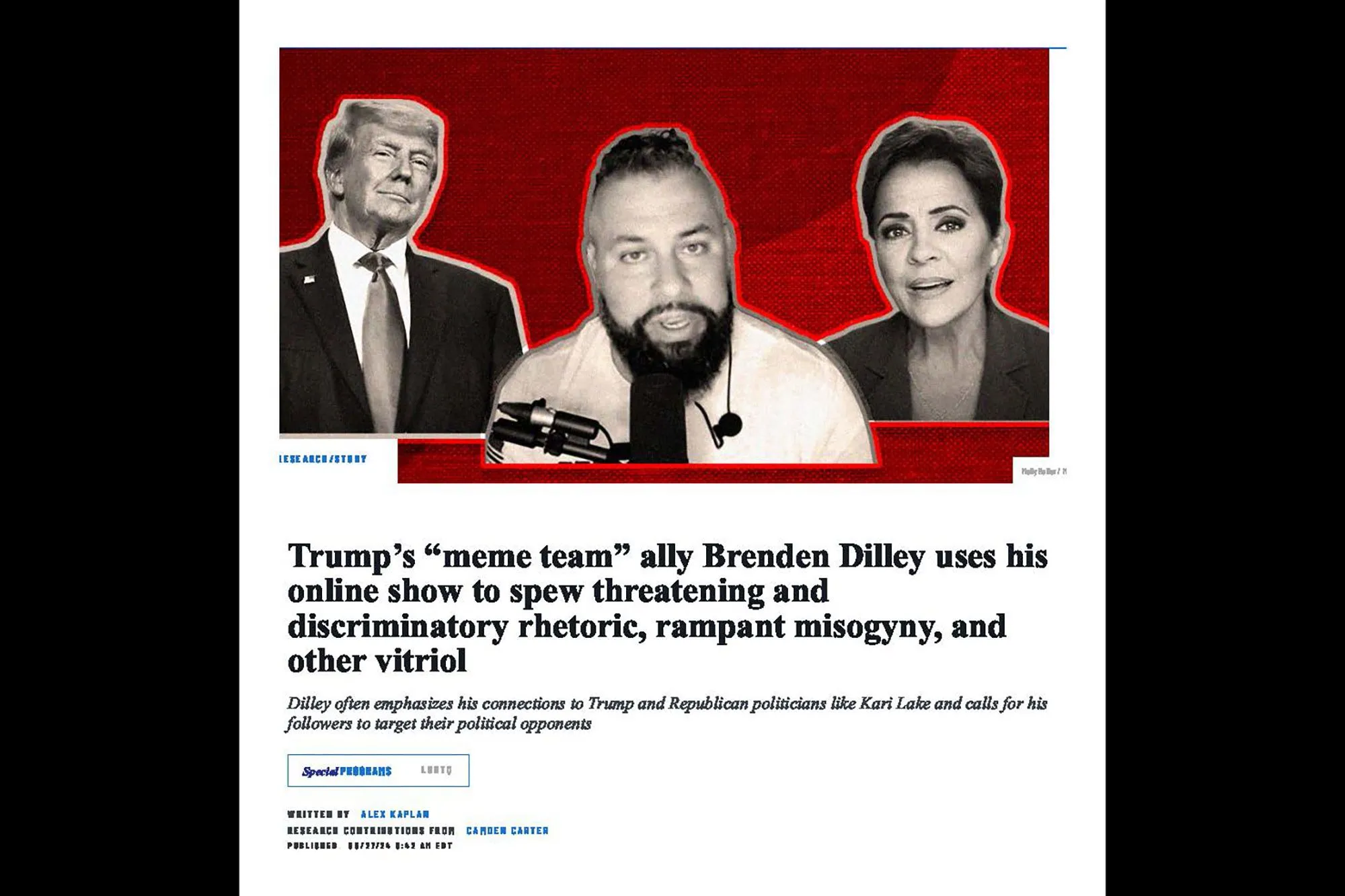

Các cuộc điều tra gần đây xác nhận rằng việc quảng bá bằng bot mở rộng sang nội dung chính trị cực đoan. Trong năm 2024 và 2025, các báo cáo đã xác định các nỗ lực phối hợp nhằm khuếch đại những người có ảnh hưởng cánh hữu liên quan đến việc phủ nhận kết quả bầu cử và tuyên truyền nước ngoài, bao gồm các hoạt động liên kết với Nga. Các tài khoản này nhận được lượng tương tác không xác thực cao, làm bóp méo cả tầm với và tính hợp pháp được nhận thức. Một khi một bài đăng thu hút đủ tương tác — thật hay giả — nó sẽ có được động lực thuật toán và khả năng hiển thị rộng hơn, củng cố ảnh hưởng của nó.

Các ưu đãi của nền tảng càng củng cố vấn đề. Twitter đã loại bỏ các hệ thống kiểm duyệt cốt lõi, cho phép xác minh trả phí để tăng cường tầm với của thuật toán và cho phép các mạng lưới bot thao túng nội dung thịnh hành. Các biện pháp bảo vệ nội bộ chống lại hành vi không xác thực có phối hợp đã bị giảm hoặc loại bỏ, cho phép các tác nhân thông tin sai lệch nổi tiếng có khả năng hiển thị liên tục. Các nỗ lực chống lại những câu chuyện này thường ít được chú ý hoặc bị hạn chế theo thiết kế.

Cơ sở hạ tầng ưu tiên tương tác hơn độ chính xác và tầm với hơn độ tin cậy. Thông tin sai lệch phát triển mạnh không phải vì nó có tính thuyết phục, mà vì các hệ thống được xây dựng để thưởng cho tương tác bất kể nguồn gốc của nó. Cấu trúc đó phản ánh tiền đề cốt lõi của Lý thuyết Internet Chết — không phải internet nghĩa đen là đã chết, mà là các tín hiệu tổng hợp đã làm lu mờ sự tương tác đích thực của con người. Trên mạng xã hội, những sự bóp méo đó không còn là lý thuyết nữa — chúng có thể đo lường được, được kiếm tiền từ và phổ biến rộng rãi.

Thông tin sai lệch nội địa từ "meme team" của Brenden Dilley, cho thấy sự phối hợp để khuếch đại nội dung chính trị.Nguồn: Media Matters

Thông tin sai lệch nội địa từ "meme team" của Brenden Dilley, cho thấy sự phối hợp để khuếch đại nội dung chính trị.Nguồn: Media Matters

Nhận diện hệ thống thông tin sai lệch kỹ thuật số và cách đối phó

Cách các “troll farm” hiện đại tạo ra thông tin sai lệch quy mô lớn

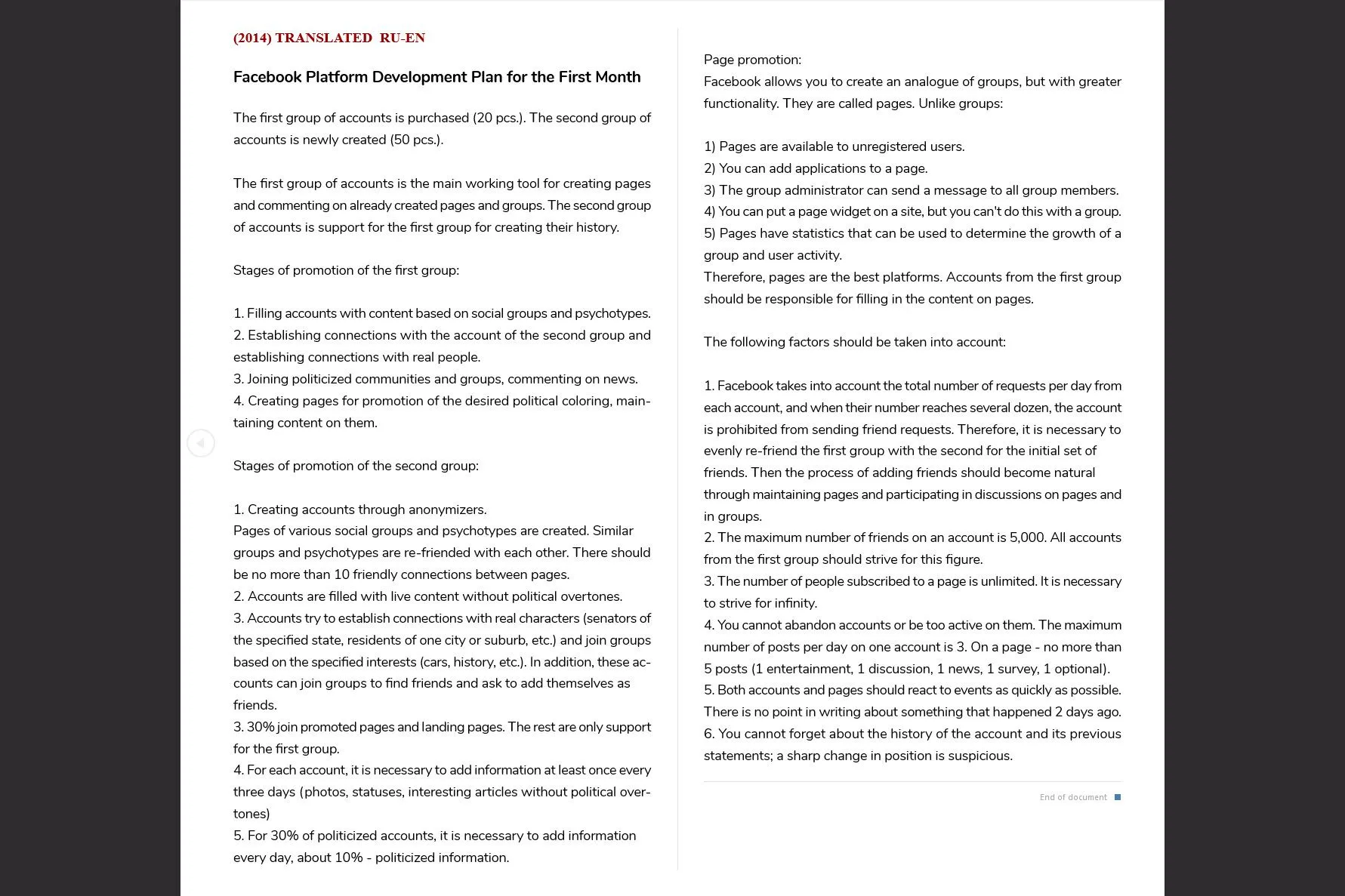

Các troll farm tuyển dụng nhân viên thông qua các danh sách việc làm nhập liệu dữ liệu mơ hồ. Sau khi ký các thỏa thuận không tiết lộ, nhân viên mới được thông báo rằng nhiệm vụ thực sự của họ là đóng giả người Mỹ hoặc công dân của quốc gia mục tiêu. Mỗi nhân viên quản lý nhiều nhân vật giả mạo trên các nền tảng như Facebook, Twitter, Instagram và Telegram. Họ được cung cấp tiểu sử theo kịch bản, các bộ sưu tập ảnh được tuyển chọn và thư viện nội dung chính trị phù hợp. Một người điều hành có thể điều hành mười hoặc nhiều nhân vật cùng một lúc, mỗi nhân vật có tên, tiểu sử, giọng điệu địa phương và quan điểm ý thức hệ riêng.

Cấu trúc này mang tính hệ thống. Nhân viên hoạt động theo ca luân phiên dưới sự giám sát của các trưởng nhóm, những người giao các chủ đề hàng ngày, xem xét hiệu suất và thực thi định mức tương tác nghiêm ngặt. Nhân viên sẽ bị cảnh cáo hoặc thay thế nếu một nhân vật không tạo ra đủ phản hồi, lượt thích hoặc lượt chia sẻ. Nhân viên đăng meme, tranh luận, các video viral và nội dung “mồi cảm xúc”, thường được lấy từ các kho lưu trữ đã được phê duyệt trước. Ngày càng có nhiều trang trại sử dụng nội dung do AI tạo ra làm cơ sở, được chỉnh sửa nhẹ để phù hợp với giọng điệu hoặc đặc điểm nhân vật.

Hướng dẫn vận hành của các troll farm trên Facebook, được dịch sang tiếng Anh, chi tiết cách tạo và quản lý các tài khoản giả mạo.Nguồn: Benn Jordan

Hướng dẫn vận hành của các troll farm trên Facebook, được dịch sang tiếng Anh, chi tiết cách tạo và quản lý các tài khoản giả mạo.Nguồn: Benn Jordan

Các hướng dẫn vận hành bị rò rỉ từ IRA và các hoạt động tương tự hướng dẫn nhân viên duy trì hành vi đáng tin cậy. Họ được yêu cầu đăng nội dung phi chính trị vài ngày một lần — những câu chuyện cá nhân, tiêu đề tin tức địa phương, ảnh thú cưng hoặc đồ ăn — để hòa nhập với người dùng đích thực. Các tài khoản nhân vật dự kiến sẽ tham gia các nhóm cộng đồng, theo dõi các chính trị gia và doanh nghiệp, và tương tác với các chủ đề thịnh hành. Có các giao thức cụ thể về thời điểm bình luận, thời điểm phản ứng và cách leo thang bài đăng để nó trông có vẻ viral.

Nhân viên thường được giao nhiệm vụ đóng nhiều vai trong cùng một vấn đề. Sử dụng các nhân vật đối lập, họ dàn dựng các cuộc tranh luận gay gắt trong các phần bình luận để thu hút người dùng thật. Những cuộc trao đổi này được thiết kế không phải để thuyết phục mà để gây rối, khuếch đại sự nhầm lẫn, phẫn nộ hoặc chủ nghĩa bộ lạc. Một số tài khoản đẩy các thuyết âm mưu, trong khi những tài khoản khác kiểm tra tính xác thực của chúng. Mục tiêu là làm xói mòn lòng tin và làm mờ sự đồng thuận, chứ không phải xây dựng nó.

Các troll farm và bot farm hiện đại giống các công ty tiếp thị kỹ thuật số. Họ sử dụng bảng điều khiển hiệu suất, lịch nội dung, theo dõi định mức và hướng dẫn phong cách. Một số đội tập trung vào việc gieo rắc thông tin sai lệch, và những đội khác tăng cường tương tác để tạo ra ảo ảnh về sự đồng thuận. Giống như các chiến dịch, họ thực hiện theo chu kỳ, nhắm mục tiêu vào các vấn đề, đối tượng nhân khẩu học hoặc bầu cử cụ thể. Điều xuất hiện như một cuộc tranh luận hữu cơ thường được tạo ra từng bài đăng, từng ca làm việc và từng kịch bản.

Cách nhận biết nội dung không xác thực — và ngừng tiếp tay cho nó

Hầu hết mọi người không cần các công cụ học thuật để phát hiện một tài khoản giả mạo — họ chỉ cần chú ý. Nếu một bài đăng kích hoạt phản ứng cảm xúc ngay lập tức, hãy dừng lại. Các troll farm và mạng lưới bot dựa vào sự phẫn nộ được tạo ra để chuyển hướng sự chú ý của bạn sang sự chia rẽ. Đó là sản phẩm: không phải bài đăng, mà là phản ứng của bạn.

Nếu bạn không chắc chắn và cảm thấy muốn tìm hiểu, hãy nhấp vào hồ sơ của người đăng. Bạn không cần phải điều tra kỹ lưỡng — chỉ cần lướt qua. Nhìn vào tên, ảnh đại diện và tiểu sử. Các tài khoản giả mạo thường tuân theo các xu hướng. Một tuần là ảnh đại diện nghệ thuật vector, tuần tiếp theo là ảnh với ánh sáng ấn tượng và khẩu hiệu mơ hồ, tạo động lực. Chúng có thể sử dụng cấu trúc đặt tên tương tự hoặc thiếu bất kỳ thông tin cá nhân cụ thể nào. Người thật không nhất quán. Bot tuân theo các mẫu.

Các mẫu hình ảnh thu nhỏ (thumbnail) là một dấu hiệu dễ nhận biết khác, đặc biệt trên các nền tảng như TikTok hoặc Instagram. Hồ sơ của người thật thường phản ánh cuộc sống của họ — khuôn mặt, địa điểm, sự kiện và các sở thích ngẫu nhiên. Các tài khoản bot thường hiển thị các hàng hình ảnh thu nhỏ với phong cách gần như giống hệt nhau: cùng phông chữ, cùng tư thế, cùng chủ đề, lặp đi lặp lại không ngừng trên hàng chục hoặc hàng trăm tài khoản. Nếu bạn nhận thấy điều đó, bạn không phải đang tưởng tượng.

Ngôn ngữ cũng tố cáo chúng. Một số bot sử dụng các hashtag và cụm từ mang tính cảm xúc như mồi nhử; những bot khác cố gắng tỏ ra bình tĩnh và “hợp lý” trong khi âm thầm lan truyền thông tin sai lệch. Dù bằng cách nào, dấu hiệu nhận biết là sự lặp lại. Nếu một bình luận trông giống hàng chục bình luận khác mà bạn đã thấy, đó là vì nó như vậy. Bot sao chép từ một kịch bản vì các kịch bản hoạt động hiệu quả.

- Tạm dừng nếu nó khiến bạn tức giận — cảm xúc mạnh là một dấu hiệu cảnh báo.

- Nhấp vào hồ sơ — người thật có sự ngẫu nhiên: bạn bè, ảnh, những điều kỳ lạ.

- Quét tìm các mẫu — tìm kiếm tên, tiểu sử hoặc hình ảnh thu nhỏ lặp đi lặp lại.

- Tin vào “linh cảm” của bạn — nếu nó có vẻ dàn dựng hoặc theo kịch bản, có lẽ đúng như vậy.

- Hạn chế trả lời — nếu bạn đã tranh cãi qua lại một hoặc hai lần, đừng để bị cuốn vào vòng lặp.

Quy tắc đơn giản nhất? Nếu cảm thấy có điều gì đó không ổn, đừng tương tác. Nếu một bài đăng đọc như thể nó được tạo ra, hoặc tài khoản có vẻ được trau chuốt kỳ lạ và trống rỗng, thì có lẽ đúng như vậy. Và nếu bạn không thể kiềm chế được, đừng tranh cãi — chỉ cần để lại một bình luận nói rằng, “Tôi đã kiểm tra. Đây là một con bot.” Bạn đã hoàn thành công việc rồi. Nếu bạn đã trải qua vài vòng tranh cãi độc hại, đó là lúc bạn nên dừng lại. Mỗi phản hồi đều nuôi dưỡng hệ thống, vì vậy hãy giữ tương tác ở mức tối thiểu và tiếp tục.

Internet chưa chết, nhưng đã bị chiếm lĩnh hoàn toàn

Internet ngày nay phản ánh một sự chuyển dịch trong kiểm soát — từ con người, sang các hệ thống được thiết kế để thao túng sự chú ý. Thông tin sai lệch không còn chỉ là một chiến thuật. Nó là một ngành công nghiệp. Các botnet được phối hợp, các nhân vật được điều khiển bởi AI và các thuật toán được tối ưu hóa tương tác đã xây dựng một thực tế thưởng cho sự phẫn nộ, chôn vùi sự thật và bóp méo những gì là thật.

Đây không phải là những vấn đề trừu tượng. Chúng xuất hiện trong dòng tin của bạn, trong các cuộc trò chuyện của bạn và trong cảm giác của bạn về những gì phổ biến hay đúng đắn. Và mặc dù dễ cảm thấy bị áp đảo, nhưng các dấu hiệu thao túng vẫn có thể nhìn thấy — nếu bạn biết phải tìm kiếm điều gì: sự lặp lại, mồi cảm xúc, các tài khoản chung chung với khả năng hiển thị bị thổi phồng. Hầu hết mọi người đã cảm thấy có điều gì đó không ổn. Họ chỉ chưa được cho biết phải làm gì với nó.

Một thế hệ nền tảng mới đang xuất hiện — phi tập trung, được quản lý bởi người dùng và được thiết kế để chống lại những thất bại của các mạng lưới cũ. Mastodon và Bluesky (thay thế Twitter), Pixelfed (thay thế Instagram), PeerTube (thay thế YouTube) và Skylight Social (thay thế TikTok) được xây dựng trên các giao thức mở, mang lại cho người dùng quyền sở hữu thực sự đối với những gì họ thấy và chia sẻ. Việc kiểm duyệt là minh bạch và được cộng đồng điều khiển, không bị các hệ thống mờ ám ra lệnh. Bot phải đối mặt với ma sát thực sự thông qua các danh sách chặn chung và sự giám sát của công chúng. Đây không chỉ là những lựa chọn thay thế — chúng là sự viết lại cấu trúc của chính mạng xã hội, với quyền riêng tư, quyền tự chủ và tính toàn vẹn làm cốt lõi.

Không có nút đặt lại. Nhưng có một con đường phía trước. Chúng ta phải trở thành những người tham gia tích cực trong việc định hình môi trường kỹ thuật số của mình thay vì những người tiêu dùng thụ động của những ảo ảnh được chọn lọc.